系列文章:

对于私有云环境的安全建设工作中,需要做的事务繁杂而冗长。但我们在梳理要点后,会发现非传统边界的加固工作,也是我们应该重点关注的。

首先,我们需要关注私有云环境的访问控制问题,在实现一定程度的可信准入后,对各层次的边界进行鉴权和认证;另外,我们需要针对潜在外部的大流量,以及容器间的流量风暴,通过代理集群和容灾多活的方式,进行分流防御处理;当然,无论是IDC资源还是容器资源,我们都务必要做好主机加固的工作,阻止黑客进行权限提升和横向扩散。

主机加固

端口策略

出入策略

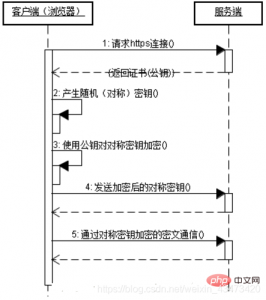

在对网络边界的安全进行设计时,我们需要对出入端口的访问控制策略,进行精细化的控制。

云环境边界:

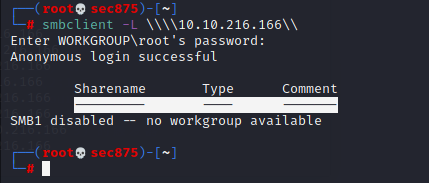

对于云环境边界的宿主机和IDC来说,端口开放的越多,意味着攻击面会扩大。而它们被黑客尝试或者存在风险的可能性,也会越大。

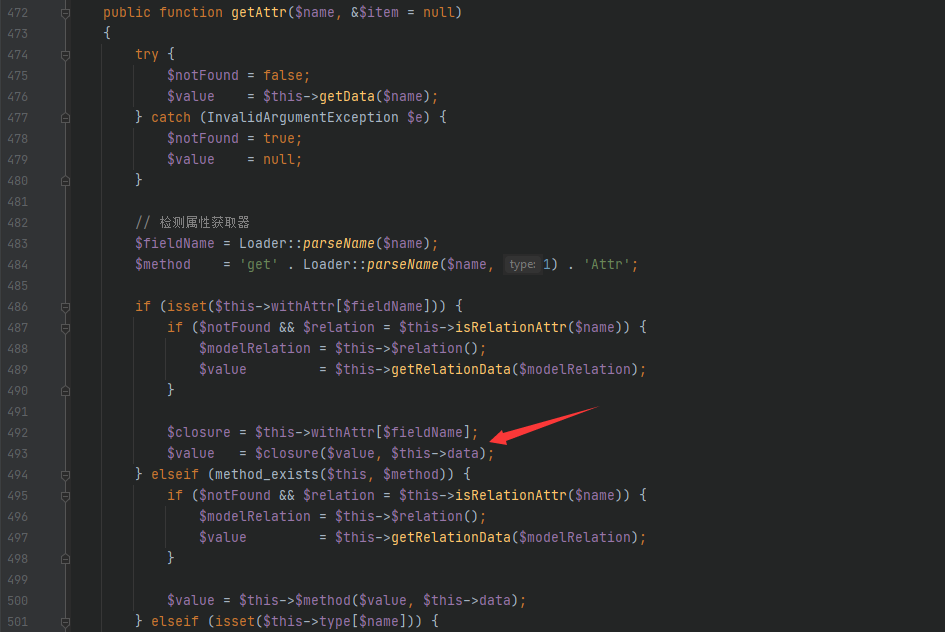

所以在此逻辑基础上,这些主机需要依赖云容器管理平台和人工配置,借助类iptables的系统工具,对开放的端口实行最小化原则,同时也要对所有的端口进行严格的认证控制,保障基础的传统边界控制。

安全域隔离边界:

至于云环境网络隔离区,则相对来说没有没那么严格。在不同的服务之间,本身可能会存在流量交互,所以进出口规则会比较复杂,变动也会相对来说更多,如果同样采用最小化策略,可能会对业务带来比较多的困扰。

但是,对于网络隔离区的出入策略,对于端口控制,也是需要做好认证和鉴权的,这块儿的内容也需要云管平台去做统一的配置管理。

流量监控

对于端口出入的流量,我们除了做好异常流控,保证网络稳定以外,也需要对其中的流量进行监控检测。

在黑客通过手段获取了云环境内主机的临时权限后,可能会尝试横向移动或者后门反弹,抑或直接进行数据拖取。在这种情况下,对于端口流量的监控就显得尤为重要了。

在监控到端口流量异常后,安全运营中心(SOC)可以通过行为联动进行分析告警,及时阻断隔离可能沦陷的机器的访问控制。

攻击阻断

边界WAF

在私有云环境提供对外的WEB服务时,对于外部用户可触达的范围,是需要提供WAF保护的。

在针对这部分内容的防御上,主要是针对传统URI进行访问核查,以及对API的访问控制。

其中对于接口的访问频次和流量内容,是否存在异常,都是边界WAF需要关注的。

这里显然不建议在安全域隔离边界进行WAF部署,我们应该专注对云环境边界的主机(如Nginx层)进行流量收口阻断控制,这样是相对合适的做法。

边界防火墙

对于边界防火墙的话,可以对私有云网络的内外流量进行交互限制,限制异常流量的出入。

就部署的优先级来看,是私有云边界优先于安全域隔离边界。

我们也可以在云环境边界,尝试部署硬件防火墙,再在安全域边界通过软件防火墙的形式进行补充,当然具体实施要看情况而定。

在实际部署的过程中,我们可能会遇到预算有限、业务复杂性较高、网络稳定性要求高等多重问题困扰。

所以我们需要在保障最低安全标准的情况下,对相关安全能力逐步进行建设和方案优化。

HIDS

在边界主机上,我们部署HIDS的同时,进行日志的留存分析也是很有必要的。

在入侵事件发生的事前和事中,我们可以通过内网态势感知(日志流量的监控联动),对攻击进行拦截阻断。

而边界主机上的HIDS的监控告警和相关安全日志,能帮助安全运维人员更好的治病于腠理。

另外需要强调的一点,日志最好统一上传到日志分析中心(比如ELK或者Splunk),以免被拿到权限的黑客清除入侵痕迹。

分流防御

对于进入私有云环境的流量,我们首先需要做好流量控制,防止内部脆弱的网络出现稳定性故障。

负载均衡SLB:

负载均衡(Server Load Balancer)是将访问流量根据转发策略,分发到后端多台机器的流量分发控制服务,这是在流量出入口实施分

来源:freebuf.com 2020-12-01 10:10:49 by: dawner

请登录后发表评论

注册