随着移动互联网的飞速发展,网络上涌现出海量的文本、图片、语音和视频信息。

在这个流量就是金钱的时代,“黄色内容”自带流量,于是就有不法分子想借此走捷径,达到一些不可告人的目的。

而“鉴黄师”的职责就是净化网络中的涉黄内容……

说到鉴黄师,有些人表情就开始丰富起来……

我的同事也这样,表情扭曲的样子像是期待,又像是无奈……

为了刺破吃瓜少年的幻想,还鉴黄师一个清白。胡拉哥采访了一位资深的鉴黄专家,帮我们揭开内容净化的神秘面纱。说实话,我看他消瘦的样子,一定很累吧。

1.工作累不累?

我们每日审核的内容数量在亿级规模,因此完全交给人工鉴别是不现实的。当前主流的做法是采用“机器+人工”的方式。首先利用算法过滤掉大部分内容,之后交给人工判断。在算法越来越成熟的条件下,我们的工作相比之前轻松了许多。

2.算法鉴黄是什么?

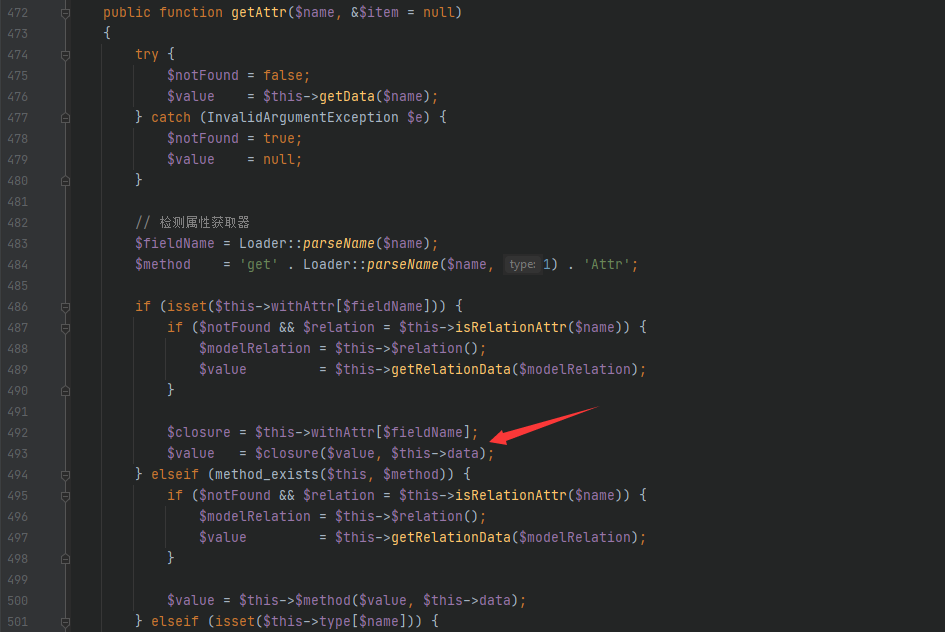

利用机器学习技术“训练”出一个“算法模型”,或者说是AI鉴黄师。通过打好标签的数据告诉机器哪些内容涉黄,哪些不涉黄。这样一来,算法模型可以自动总结出涉黄的特征(如下图所示)。

顺便说一下机器鉴黄的好处:一是效率高,可以实时检测用户上传的内容;二是检测结果客观,不受情绪影响。

3.鉴黄难不难?

下面我举几个例子来解释一下当前面临的一些挑战。

(1)可能涉黄的主体多样化。包括真人、动物、卡通、艺术等。算法模型需要针对性地考虑各种可能涉黄的主体。

以卡通为例,人物线条简单且比例失真,这些因素会增加算法判断的难度。

(2)色情内容没有绝对的标准。大致分为露点和不露点两类。前者识别起来相对容易。而不露点的内容在色情和性感之间的边界是模糊的,因此识别起来比较困难。

(3)“非通用”色情内容不好判断。以情趣用品图片为例,直观上它的危害程度不及通用色情。但是如果一个面向青少年的APP每天都在传播各种情趣用品图像,我们鉴黄师显然不能袖手旁观。

这种类型的难点在于容易误判:一方面和情趣用品外形相似的物品很多,比如某些儿童玩具;另一方面用户产生的内容中情趣用品的占比太少(大约百万分之一),如果审核严格一些,就会带来较多的误判。

(4)用户对抗。当用户上传的内容被鉴定为非法内容时,他们会采取技术手段突破算法的审核。常用的技术是用修图软件(例如Photoshop)遮挡部分内容,从而绕过算法。更高级的方法是利用机器学习技术,以己之矛攻击己之盾,通过增加人类不可见的噪声(但机器可见)来欺骗算法。

下图利用机器学习的方法给左边的熊猫增加了一些噪点,得到了右边的熊猫。人眼无法察觉左右两张照片的区别,但是算法模型却把右边的熊猫误认为长臂猿。

4.工作开心吗?

我们用技术创造一个干净和谐的互联网环境能带来职业上的成就感,但是解决问题的过程常常是痛苦的。

例如需要定期收集人工审核员的反馈结果,然后讨论一些极端案例。这些内容往往超越普通人的理解,会引起内心的极度不适。

内容审核的工作看似容易,实则要求超越常人的心理承受能力。他们每天被迫观看大量恐怖、色情和凶杀图片及视频,很多人患上了心理后遗症——经常失眠、做恶梦、脑子里充满图片和视频内容。

国外有一名内容审核人员描述了浏览这些暴力、色情和令人不安的内容给她留下的情绪损伤和心理影响,她说:“当我从MySpace离开的时候,我大概有3年的时间不肯和人握手,因为我觉得人们都很恶心。我无法触碰别人。”她称,世界上最普通的人也都是TM的怪胎。“我从那里出来的时候对人性感到厌恶。我的同僚们,大多数也和我有一样的感觉,我们都对人性留下了可怕的观感。”

来源:freebuf.com 2020-09-01 19:23:01 by: wangyiyunyidun

请登录后发表评论

注册