在实际应用场景中,AI安全专家往往能很好的解决数据量大的头部风险,对于数据量非常少,或者新增的风险,即长尾风险,现有的大模型往往难以胜任。例如出现了一波名为“邪典”的新风险,主要为一些对青少年有不良导向的视频等。

儿童邪典片是动画制作公司以儿童熟悉的卡通人物包装成为血腥暴力或软色情内容,甚至是虐童的动画或真人小短片,以教育为幌子,制作一些不适宜儿童观看的视频,扭曲未成年的价值观和世界观。

在2018年的“扫黄打非”专项整治中,此类相关内容清理有害信息就有37万余条之多,可谓让人瞠目结舌。随着短视频的火爆发展,变异极快的“儿童邪典”极易死灰复燃。

积累这样类别的数据以供原有模型训练需要一定的时间,而小样本方法恰好能填补中间的这段真空期。阿里安全图灵实验室团队使用小样本方法,在这段真空期中,很好地对该风险进行覆盖,维护互联网清朗环境。

在安全领域和众多其他领域,例如医疗、生物等领域。样本标注困难、成本高将是普遍存在的问题。阿里AI安全专家坚信,小样本学习能很好的改善这些困境。

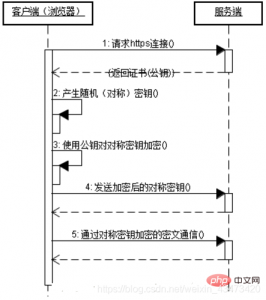

现有的state-of-the-art小样本方法大多为两个步骤,首先对backbone网络进行预训练,然后对预训练后的backbone用元学习(Meta-learning)方法进行优化,从而解决小样本分类问题。之前发表的小样本方法大都集中于优化小样本元学习阶段,例如使用不同的方式来寻找最优的embedding 空间,利用有限的类内和类间信息选择有效的样本特征等等,该研究主要集中研究小样本方法中的预训练问题。

研究者发现,使用大模型直接进行Meta learning,训练的效果并不好,研究者推测的原因是Meta Learning还是比较轻,对于大模型训练起来比较吃力。因此目前效果最好的几个方法均需要预训练特征网络,即需要先把backbone网络在训练集上进行全监督的预训练,然后再用meta learning的方式finetune。因此使用大模型预训练后的backbone网络很容易有过拟合问题,泛化性和迁移性差,在Meta learning阶段,Meta learning训练由于比较轻,所以无法对其进行有效的调整。我们称之为小样本学习中的‘curse of depth’问题。

研究者提出一种简单有效的方法(如下图):使用自监督方法预训练一个更深的网络。该backbone具有很好的鲁棒性和泛化性,使用简单的元学习方法对其进行优化就可以在两个经典小样本数据集MiniImageNet和CUB数据集上都得到state-of-the-art结果。同时,研究者使用本文中提出的方法在跨域小样本测试的四个数据集上进行了测试,同样取得了state-of-the-art结果。

![图片[1]-他们居然敢用“邪典”视频对儿童下手 看AI怎么“主持正义” – 作者:阿里安全-安全小百科](http://aqxbk.com/./wp-content/uploads/freebuf/image.3001.net/images/20210224/1614156672_6036138093f9537da7a65.jpg)

论文作者简介:

雍秦,阿里安全高级算法工程师,阿里中科院自动化所联合培养博士后,英国巴斯大学博士。主要从事利用算法技术解决业务安全问题的工作,目前集中于视频内容安全风控,负责淘宝商家视频,评价视频,等等。英国计算视觉协会会员,CVPR、ICCV、IJCAI、BMVC等会议审稿人。

作者从事的领域为计算机视觉视频理解和小样本方向,发表论文的技术亮点是在小样本场景下,使用自监督和元学习结合的方式,突破了传统小样本学习受限于纯元学习方法仅能在较小的backbone上进行优化的难题。

来源:freebuf.com 2021-02-24 16:52:58 by: 阿里安全

请登录后发表评论

注册