随着AI技术的发展,越来越多的AI技术应用进入了我们的生活,而人脸识别也成为了最常见的技术应用之一,住酒店、坐飞机高铁、使用政务便民服务等场景中,都可以见到人脸识别的应用。

然而,在新技术带来方便的同时,安全风险也随之而来,不法分子开始利用AI深度伪造技术伪造视频进行传播,扰乱社会秩序;一些地方出现利用伪造视频、假体面具等攻击人脸识别技术的案例。为把握当前世界网络传播与新技术融合发展方向,积极营造网信产业发展的良好环境,推动人脸识别等新技术在互联网信息行业发展和治理方面的应用,腾讯联合中国人工智能产业发展联盟网信技术委员会,共同举办了“人脸识别安全和深度伪造沙龙”。在沙龙上,腾讯首次对外公开了腾讯的AI攻击技术和测试研究框架并对目前的AI过脸黑色产业链进行了分析。

新技术应用便利与风险并存,“深度伪造”需警惕

人脸识别作为人工智能技术越来越被广泛应用,在安防领域更是被广泛应用于犯罪预防预警、治安交通管理、刑事案件侦查等,在追捕逃犯、发现嫌疑人身份、寻找走失人口等方面发挥了重要的作用。在社会管理中尤其是本次疫情防控中人脸识别也体现了独特的价值,在日常工作生活中人脸识别被应用在移动支付、手机解锁、考勤打卡等场景,为大家的生活提供了便利。但是,新技术的应用也带来了全新的安全风险和挑战,“深度伪造”技术的发展就是其中之一。深度伪造技术(DeepFake)最早源于2017年底在国外reddit平台上一个匿名用户发布的色情视频,他使用机器学习将色情明星的面孔替换成了名人的面孔,而深度伪造这个词也是由Deep和Fake合并而创造出来的,他实际上是指使用人工智能技术实现对图像音视频的生成或修改,达到信息内容的以假乱真,当前深度伪造中主要应用的深度学习技术,包括了生成对抗网络GAN、辩分解码器VAE还有神经网络CNN等等。网信办技术委员会领导在沙龙上指出“借助人脸识别深度学习等技术,操纵图像视频内容,深度伪造已经成为换脸的代名词,目前网络上已经出现一些明星以及国外政治人物的深度伪造音视频材料,普通用户很难辨别其真实性。如不及时规范深度伪造的应用,一旦用于别有用心的目的,轻者造成信息受损,重者危害公共安全社会安全甚至政治安全隐患。”

腾讯首次公开AI攻击技术和测试研究框架

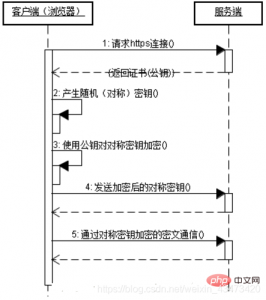

在沙龙上,腾讯云安全副总经理李滨分享了腾讯公司针对当前不法分子利用AI技术进行黑产和网络犯罪活动的对抗研究与经验,以及针对AI应用进行系统化安全分析和防御的成果。李滨认为,虽然AI安全的核心是算法和数据,但在分析整个AI风险面的时候不能仅仅考虑这两个方面,而应该结合应用流程和技术堆栈两个维度,进行端到端的风险面分析和系统化的安全防护。AI系统的核心构建包括训练和推理两个关键环节,在构建AI应用系统的过程中,除了大家广泛认知到的模型和算法安全问题外,还可能面临数据安全和隐私保护、软件供应链的安全、软硬件系统和应用安全、传感器和端侧计算环境安全、以及数据流的完整性等方面的安全风险。

(从技术栈角度进行端到端的分析)

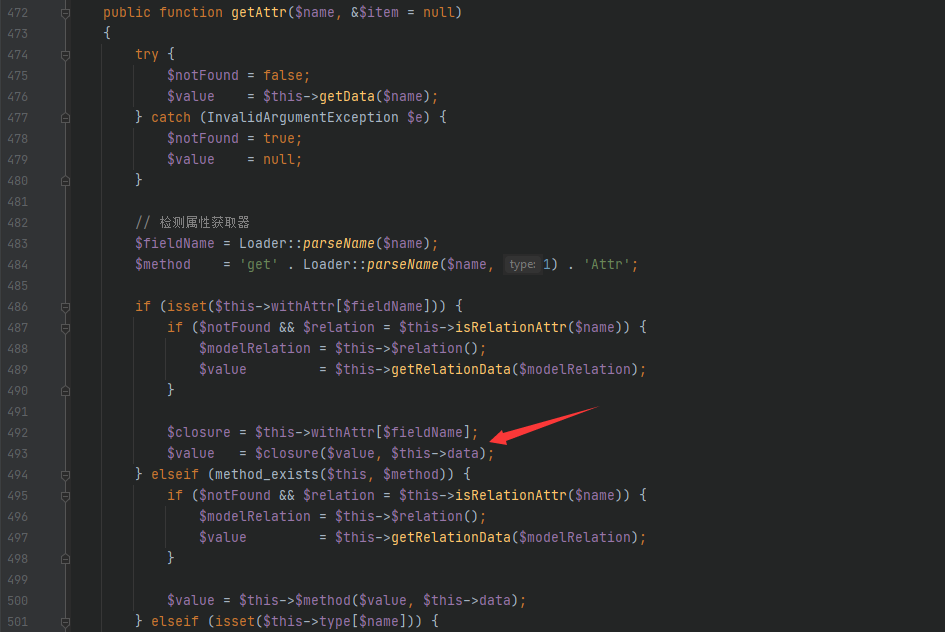

在AI模型训练和推理的计算过程当中每个数据处理的流程环节有不同的攻击手法。例如在训练阶段,可能获取的训练数据集本身是存在缺陷或偏差的,甚至会面临攻击者对训练数据集进行投毒,这些都会对最终模型的稳定性造成影响。在训练和推理计算过程中也面临包括针对数据预处理、抽样、整形等模型算法实现的攻击手段。在当前的AI应用环境中最常被忽视的是数据源和数据流完整性方面的问题,在数据采集的部分包括端侧设备破解和劫持、传感器干扰、侧信道攻击、数据流的劫持等等问题,这些攻击手段常常会从源头上绕过或干扰AI系统的决策机制。最后在决策执行的过程当中还面临通过平台漏洞对系统的执行流和数据流进行攻击,以窜改最终运行结果这样的攻击行为。

(从应用流程的角度进行端到端分析)

同时,李滨首次对外发布了腾讯的AI攻击技术和测试研究的框架。该研究框架分成AI的模型和算法安全、软件生态和应用开发安全、智能硬件以及嵌入式安全、以及应用和业务风控这四个大的领域。目前腾讯安全云鼎实验室已经总结了各个领域上百种的攻击,其中针对AI软件和框架的专项针对性攻击超过20种。

(腾讯的AI攻击技术和测试研究的框架)

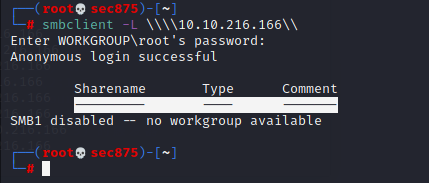

聚焦深度伪造黑产链条,针对源头进行打击

深度伪造作为AI攻击中最常用的一种技术手段,已经被不法分子利用。不法分子通过获取公民的个人信息、人脸信息从而绕过政企服务和互联网公司的安全策略,利用深度伪造的技术加上一些身份信息和一些信息的诈骗实现人脸实名认证从而达到谋利的目的,形成了AI过脸的黑色产业链。腾讯守护者计划安全专家黄汉川在沙龙上介绍,身份信息和清晰的照片是“AI过脸黑色产业链”的源头,而公民个人信息的泄露主要可能由企事业单位内鬼售卖泄密和黑客入侵两种途径造成。拿到个人信息后,不法分子使用深度伪造技术并结合摄像头劫持等攻击手段绕过政府、企业、互联网公司的安全策略,从而进行恶意账号注册,大量账号就会用于诈骗、洗钱、薅羊毛等等各种具体的违法犯罪活动上。

但是,黄汉川认为并不用因为人脸识别技术存在被利用的风险就产生不必要的恐慌,目前以腾讯为代表的科技企业,已经通过技术对抗技术,利用成熟的技术和安全策略去识别深度伪造的音视频等,并通过技术手段溯源协助警方进行黑产打击。同时,用户也要注意保护自己的个人隐私信息,不要轻易的提供自己的个人隐私,不轻易的发布自己的人脸照片等。

来源:freebuf.com 2020-05-12 16:07:07 by: 云鼎实验室

请登录后发表评论

注册